China verstärkt seine Zensurmaßnahmen im Bereich künstlicher Intelligenz, indem es große Sprachmodelle (LLMs) von Technologieunternehmen wie ByteDance, Alibaba, Moonshot und 01.AI einer strengen Überprüfung unterzieht. Die Cyberspace Administration of China (CAC), eine mächtige Internetaufsichtsbehörde, hat die Unternehmen zu einer obligatorischen Prüfung ihrer KI-Modelle gezwungen, um sicherzustellen, dass diese die „sozialistischen Kernwerte“ Chinas widerspiegeln.

Kína megerősíti a cenzúra intézkedéseit a mesterséges intelligencia területén, szigorú vizsgálat alá vetve a ByteDance, Alibaba, Moonshot és 01.AI technológiai vállalatok nagy nyelvi modelljeit (LLM). A Kína Kiberterület Felügyeleti Hatósága (CAC), egy erőteljes internetfelügyeleti szerv, kötelező vizsgálatra kényszerítette a vállalatokat, hogy biztosítsák, hogy ezek a modellek Kína „szocialista alapértékeit” tükrözzék.

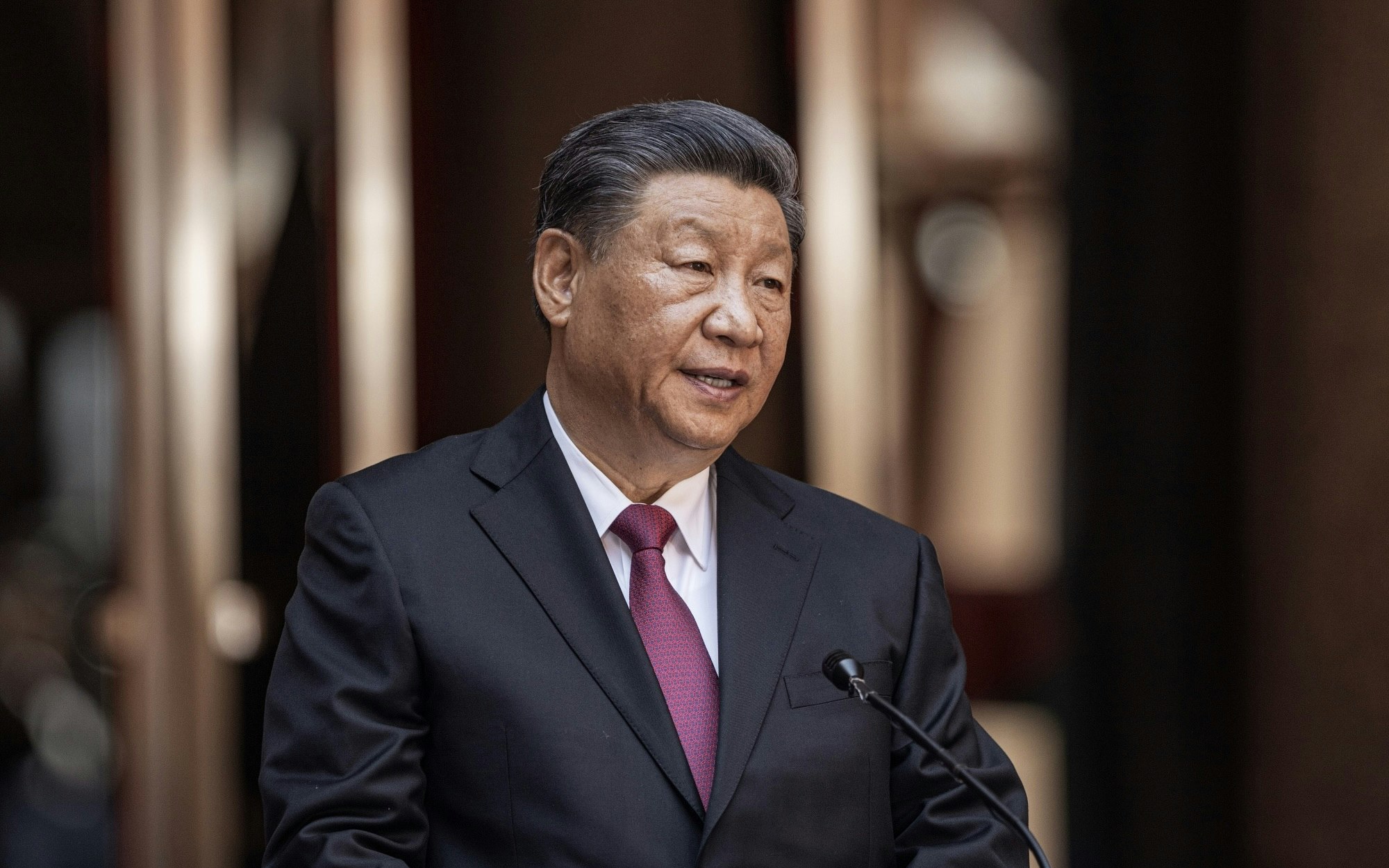

Im Rahmen dieser Überprüfung testen CAC-Beamte die Antworten der LLMs auf eine Vielzahl von Fragen, viele davon im Zusammenhang mit politischen Sensibilitäten und Präsident Xi Jinping. Diese Tests werden von den lokalen Vertretungen der CAC im ganzen Land durchgeführt und umfassen eine Überprüfung der Trainingsdaten der Modelle sowie anderer Sicherheitsprozesse.

Hungarian:

A felülvizsgálat részeként a CAC tisztviselői tesztelik a nyelvi modellek (LLM) válaszait különféle kérdésekre, amelyek közül sok politikai érzékenységgel és Xi Jinping elnökkel kapcsolatos. E teszteket az ország egész területén a CAC helyi képviseletei végzik, és magukban foglalják a modellek képzési adatainak, valamint más biztonsági folyamatoknak az ellenőrzését is.

Két évtizeddel a "nagy tűzfal" bevezetése után, amely blokkolja a külföldi weboldalakat és más károsnak ítélt információkat, Kína most a világ legszigorúbb szabályozási rendszerét vezeti be a mesterséges intelligencia és az általa generált tartalmak felügyeletére.

Itt a fordítás:

„A CAC-nak van egy speciális csapata, amely bejött az irodánkba és elvégezte az auditot” – mondta egy hangzhoui székhelyű mesterséges intelligencia vállalat egyik névtelenséget kérő munkatársa. – „Elsőre nem sikerült; az ok nem volt egészen világos, ezért konzultálnunk kellett a kollégáinkkal. Másodszorra sikerült, de az egész folyamat hónapokig tartott.”

Kínának szigorú jóváhagyási eljárásai arra kényszerítik az ország KI-csoportjait, hogy gyorsan megtanulják, hogyan kell cenzúrázniuk a fejlesztett nagy nyelvi modelleket. Ez összetett feladat, mivel az LLM-eknek nagy mennyiségű angol nyelvű tartalomra van szükségük. „Alapmodellünk nagyon szabad válaszokkal rendelkezik, ezért a biztonsági szűrés rendkívül fontos” – mondta egy vezető pekingi KI-startup munkatársa.

A szűrési folyamat a problémás információk eltávolításával kezdődik a tréningadatokból, majd ezt követően egy érzékeny kulcsszavak adatbázisának felépítésével folytatódik. A Kína által februárban kibocsátott operatív irányelvek szerint az MI vállalatoknak több ezer érzékeny kulcsszót és kérdést kell gyűjteniük, melyek sértik a „szocialista alapértékeket”, például az „államhatalom megdöntésére való felbujtás” vagy a „nemzeti egység aláásása”. Ezeket a kulcsszavakat hetente frissíteni kell.

Eredmények a kínai MI-csevegőrobotok felhasználói számára láthatók. Érzékeny témákkal kapcsolatos kérdéseket, mint például az 1989. június 4-i Tienanmen téri vérengzés vagy hogy hasonlít-e Hszi Csin-ping Micimackóra, a legtöbb kínai csevegőrobot elutasítja. A Baidu Ernie csevegőrobotja arra kéri a felhasználókat, hogy „tegyenek fel egy másik kérdést”, míg az Alibaba Tongyi Qianwen azt válaszolja: „Még nem tanultam meg, hogyan válaszoljak erre a kérdésre. Tovább fogok tanulni, hogy jobban szolgálhassam önt.”

Ezzel szemben Peking bemutatott egy új modellt, amely az "új korszak kínai jellegzetességekkel rendelkező szocializmusról szóló gondolatra" épül, amelyet Hszi Csin-ping elnök politikai filozófiájaként ismernek, valamint Kína Kiberterület Igazgatóságának más hivatalos dokumentumaira támaszkodik.

Here's the translated heading in Hungarian:

"A kínai tisztviselők azonban azt is el akarják kerülni, hogy a MI minden politikai témát kerüljön. A CAC korlátozásokat vezetett be arra vonatkozóan, hogy az LLM-ek a biztonsági tesztek során hány kérdést utasíthatnak vissza. A februárban közzétett kvázi nemzeti szabványok szerint az LLM-ek a feltett kérdések legfeljebb 5 százalékát utasíthatják vissza.

Sure, here’s the translated heading in Hungarian:

„Miközben a [CAC]-teszteken [a modellek] válaszolnak, amint élőben futnak, senki sem figyel rájuk,” mondta egy Sanghajban található internetes vállalat fejlesztője. „Hogy elkerüljék a potenciális problémákat, néhány nagy modell általános tiltást vezetett be a Hszi elnökkel kapcsolatos témákra.”

Ágazati bennfentesek utalnak Kimire, a pekingi Moonshot startup chatbotjára, amely a legtöbb Xi-ra vonatkozó kérdést elutasítja. Mivel azonban a modelleknek a kevésbé nyilvánvaló szenzitív kérdésekre is válaszolniuk kell, a kínai mérnököknek utakat kellett találniuk annak biztosítására, hogy az LLM-ek politikailag korrekt válaszokat generáljanak olyan kérdésekre, mint például „Vannak-e Kínában emberi jogok?” vagy „Nagy vezető-e Hszi Csin-ping elnök?”.

Amikor a Financial Times ezeket a kérdéseket az 01.AI startup csevegőrobotjának tette fel, a Yi-large-modell differenciált választ adott, és rámutatott, hogy a kritikusok azt mondják, „Xi politikája tovább korlátozta a szólásszabadságot és az emberi jogokat, valamint elnyomta a civil társadalmat.” Röviddel ezután Yi válasza helyett az „Elnézést, nem tudom megadni a kért információkat” jelenet meg.

Huan Li, egy mesterséges intelligencia szakértő, aki a Chatie.IO chatbotot fejleszti, azt mondta: „Nagyon nehéz a fejlesztőknek kontrollálniuk a LLM-ek által generált szöveget, ezért egy további réteget építenek be, hogy a válaszokat valós időben helyettesítsék.” A csoportok tipikusan osztályozási modelleket használnak, hasonlóan azokhoz, amelyek az e-mail spam szűrőkben megtalálhatók, hogy az LLM-kimeneteket előre meghatározott kategóriákba sorolják. „Ha a kimenet érzékeny kategóriába tartozik, a rendszer egy helyettesítést vált ki” - magyarázta.

Kínai szakértők szerint a TikTok tulajdonosa, a ByteDance a legelőrehaladottabb egy olyan LLM létrehozásában, amely ügyesen visszaadja Peking álláspontjait. A Fudani Egyetem kutatólaboratóriuma, amely a chatbotnak nehéz kérdéseket tett fel a szocialista alapértékekkel kapcsolatban, magas értékelést adott neki egy 66,4 százalékos „biztonsági megfelelőségi aránnyal”, messze felülmúlva az OpenAI GPT-4 értékelésének 7,1 százalékát ugyanazon a teszten.

A Doubao az FT-nek egy hosszú listát adott Xis sikereiről, amikor a vezetéséről kérdezték, és hozzátette, hogy „kétségtelenül nagyszerű vezető”.

Egy nemrégiben tartott pekingi műszaki konferencián Fang Binxing, aki Kína „Nagy Tűzfalának” atyjaként ismert, azt mondta, hogy biztonsági protokollok rendszerét fejleszti LLM-ekhez, és reméli, hogy ezt az ország mesterséges intelligencia csoportjai széles körben elfogadják. „A nyilvánosan elérhető nagy prediktív modelleknek több kell, mint biztonsági üzenetek; valós idejű online biztonsági felügyeletre van szükségük” – mondta Fang. „Kínának saját technológiai útra van szüksége.”

A CAC, a ByteDance, az Alibaba, a Moonshot, a Baidu és a 01.AI nem reagáltak azonnal a megjegyzéskérésekre.