AI

Amazon attacca Nvidia con propri chip di intelligenza artificiale

Amazon investe miliardi in propri chip AI per competere con il leader di mercato Nvidia e ridurre i costi.

Amazon spinge più fortemente nel mercato dei semiconduttori con nuovi chip IA per ridurre la dipendenza da Nvidia e rendere più efficiente la propria infrastruttura cloud. Le Annapurna Labs di Austin, acquisite da Amazon nel 2015, hanno sviluppato la più recente generazione di chip "Trainium 2", progettata specificamente per l'addestramento IA e che verrà presentata a dicembre. Tra i primi clienti tester figurano Anthropic, Databricks e Deutsche Telekom.

L'obiettivo: offrire alternative a Nvidia. "Vogliamo essere la migliore piattaforma per Nvidia, ma è salutare avere un'alternativa", ha detto Dave Brown, Vice Presidente Compute di AWS. Amazon sottolinea che i propri chip AI – tra cui "Inferentia" – siano già il 40% più economici rispetto ai prodotti di Nvidia.

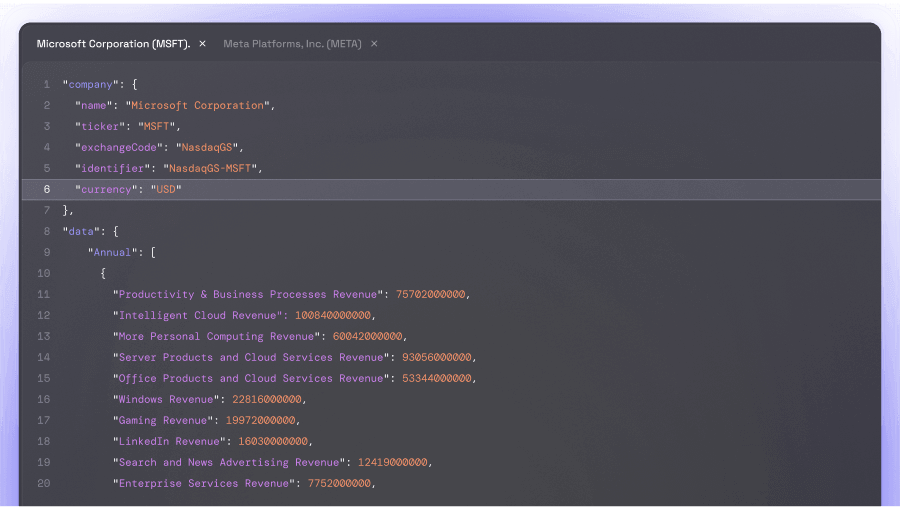

Gli investimenti di Amazon in infrastruttura e tecnologia aumentano drasticamente: nel 2024 dovrebbero raggiungere circa 75 miliardi di dollari, significativamente di più rispetto ai 48,4 miliardi dell'anno precedente. Questo sviluppo strategico si riflette anche in altri giganti tecnologici come Microsoft e Google, che investono anch'essi in chip propri per soddisfare le crescenti esigenze della rivoluzione dell'IA.

„Ogni fornitore di cloud mira a un'integrazione verticale“, afferma Daniel Newman del Futurum Group. Attraverso lo sviluppo di chip propri, aziende come Amazon e Meta ottengono vantaggi in termini di costi e maggior controllo.

Il tentativo contro Nvidia mostra finora solo un effetto limitato.